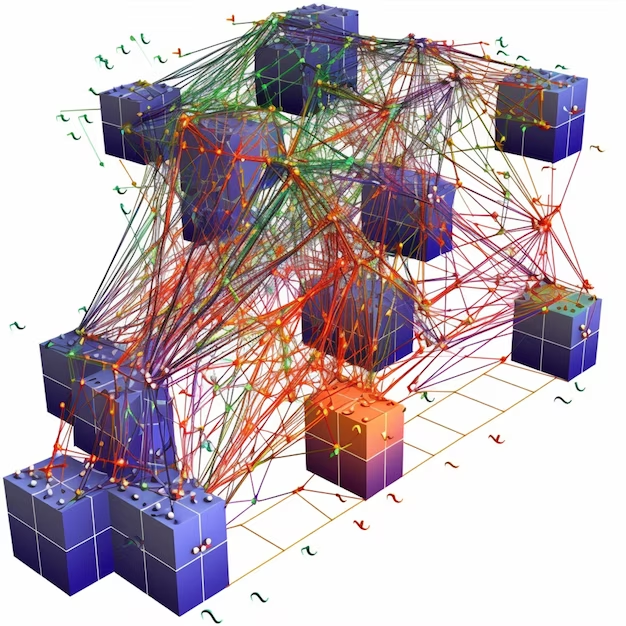

Вы когда-нибудь задумывались, как машины распознают изображения, обрабатывают языки или даже играют в игры? В основе этих задач лежат нейронные сети. Вдохновленные сложными сетями нейронов в нашем мозге, эти алгоритмы обрабатывают и передают информацию уникальными способами, обеспечивая основу для современного искусственного интеллекта. Нейронные сети произвели революцию во многих отраслях, от здравоохранения до финансов, и понимание их архитектуры может дать нам представление об их возможностях.

Начало: Персептроны

Развитие нейронных сетей началось с персептрона в конце 1950-х годов. Задуманный Фрэнком Розенблаттом, это была упрощенная модель, предназначенная для имитации базовой функции нейрона. Эта архитектура, хотя и рудиментарная, заложила основу для будущих сетей. Обрабатывая входные данные, присваивая веса и выдавая выходные данные с помощью функции активации, perceptrons продемонстрировали потенциал обучения на основе алгоритмов.

Расцвет глубокого обучения

По мере увеличения вычислительной мощности расширялись сложность и возможности нейронных сетей, что привело к тому, что мы сейчас называем “”глубоким обучением””. Эти сети, более глубокие, чем их предшественники, способны обрабатывать огромные объемы информации, выявляя закономерности и нюансы, которые ранее были невообразимы.

- Нейронные сети прямой связи Первой остановкой в нашем путешествии по глубокому обучению является нейронная сеть прямой связи. Эти сети передают информацию в одном направлении, от ввода к выводу. Простые, но эффективные, они используются для решения множества задач, от регрессии до классификации. Прелесть сетей прямой связи заключается в их прозрачности: данные перемещаются линейно, что делает процесс обучения простым и интуитивно понятным.

- Сверточные нейронные сети (CNNS) Когда вы загружаете фотографию на платформу, и она мгновенно распознает лица, скорее всего, работает CNN. В CNNS, используемых в основном при обработке изображений, используются слои, которые сканируют входные изображения небольшими фрагментами, выделяя такие шаблоны, как края, текстуры и формы. Их уникальная архитектура, которая отражает визуальную обработку в человеческом мозге, делает их незаменимыми для решения любых задач, связанных с визуальными эффектами.

- Рекуррентные нейронные сети (RNN) Представьте, что вы читаете эту статью слово за словом, забывая предыдущее слово, как только переходите к следующему. Неэффективно, верно? В этом и заключается блеск RNN. Подходящие для задач с последовательными данными, такими как речь или текст, RNNS сохраняют память из предыдущих входных данных, гарантируя, что контекст не будет потерян. Эта “”память”” дает им значительное преимущество в таких задачах, как перевод на другой язык или прогнозирование запасов.

- Долговременная кратковременная память (LSTM) Углубляясь, LSTM, особый вид RNN, устраняют некоторые ограничения своей родительской архитектуры. Традиционные RNN испытывают трудности с длинными последовательностями, часто забывая о ранних входных данных. LSTM с их уникальными стробирующими механизмами позволяют сохранять важную информацию в течение более длительных периодов времени, что делает их идеальными для таких задач, как анализ настроений в объемных документах.

- Закрытые повторяющиеся единицы (GRU) GRU, другой вариант RNN, предлагают упрощенную версию LSTMS. С меньшим количеством вентилей и параметров они могут быть быстрее и эффективнее в определенных задачах. Выбор между LSTMS и GRU? Часто это сводится к конкретным потребностям проекта и доступным вычислительным ресурсам.

Продвинутые архитектуры

Нейронные сети, как мы видели, значительно эволюционировали со времен персептрона. И по мере того, как росли наши требования, росло и разнообразие архитектур.

| Архитектура | Основное использование | Примечательная особенность |

|---|---|---|

| Нейронная сеть прямой связи | Классификация, регрессия | Линейное перемещение данных |

| Сверточная нейронная сеть (CNN) | Обработка изображений | Визуальное распознавание образов |

| Рекуррентная нейронная сеть (RNN) | Последовательная обработка данных | Память предыдущих входных данных |

| Долговременная кратковременная память (LSTM) | Анализ данных длинной последовательности | Сохранение информации в течение более длительных периодов |

| Закрытые рекуррентные единицы (GRU) | Упрощенный последовательный анализ данных | Эффективность и скорость |

Каждая архитектура, хотя и основана на фундаментальных принципах нейронной обработки, привносит в таблицу что-то уникальное. Работаете ли вы над приложением для распознавания изображений или прогнозируете тенденции фондового рынка, скорее всего, существует нейронная сеть, адаптированная для ваших нужд.

Почему разнообразие имеет значение

Разнообразие архитектур нейронных сетей – это не просто результат академического любопытства. Это необходимость. Разные задачи требуют разных подходов. Например, в то время как для распознавания настроения в рецензии на фильм могут потребоваться возможности памяти LSTM, идентификация кошки на картинке – это скорее область CNNS. Эта специализация гарантирует, что мы сможем достичь высочайшей точности и эффективности в наших задачах, управляемых искусственным интеллектом. Имея в нашем распоряжении широкий спектр инструментов, мы можем точно настраивать наши решения, что приводит к лучшим и более надежным результатам. Подумайте об этом как о разнообразном наборе инструментов: вы бы не стали использовать молоток для завинчивания болта, не так ли?

Будущее архитектур нейронных сетей

В постоянно развивающемся мире искусственного интеллекта предсказание будущего – непростая задача. Однако определенные тенденции в архитектуре нейронных сетей дают подсказки. По мере усложнения данных и увеличения спроса на обработку в режиме реального времени архитектуры, вероятно, станут еще более специализированными и эффективными. Квантовые нейронные сети, нейроморфные вычисления и сокращение сети – это всего лишь несколько областей, где назревают инновации.

- Квантовые нейронные сети Сочетая принципы квантовой физики и нейронных сетей, квантовые нейронные сети (QNNS) стремятся обеспечить беспрецедентную скорость и вычислительную мощность. Используя уникальные свойства квантовых битов или кубитов, QNN обладают потенциалом революционизировать сложные задачи, такие как задачи оптимизации и криптография.

- Нейроморфные вычисления Черпая вдохновение непосредственно из человеческого мозга, нейроморфные чипы стремятся имитировать его структуру и эффективность. Эти системы, разработанные для имитации нейронов и синапсов мозга, обещают обучение в режиме реального времени, более низкое энергопотребление и более высокую скорость обработки.

Благодаря использованию этих новейших технологий следующая волна архитектур нейронных сетей обещает еще большую универсальность, точность и эффективность. Итак, хотя мы не можем предсказать точное будущее, ясно одно: путь эволюции нейронных сетей далек от завершения.

Заключение

От простых персептронов до сложных архитектур, таких как LSTM и CNN, нейронные сети прошли долгий путь. Они стали основой, на которой построена большая часть современного искусственного интеллекта. По мере развития технологий и данных будут развиваться и эти сети, постоянно адаптируясь к решению новых задач. Широта и глубина архитектур нейронных сетей свидетельствуют о неустанном стремлении человечества к созданию машин, которые не только вычисляют, но и “”думают”” и “”учатся””. Поскольку мы стоим на пороге новых инноваций, таких как квантовые нейронные сети и нейроморфные вычисления, остается только гадать: что же дальше? И как это изменит наш мир?

Часто задаваемые вопросы

- Какой была первая архитектура нейронной сети? Первой архитектурой нейронной сети был персептрон, представленный в конце 1950-х годов Фрэнком Розенблаттом. Это была простая модель, разработанная для имитации базовой функции нейрона.

- Почему существует так много архитектур нейронных сетей? Разные задачи требуют разных подходов. По мере роста проблем в обработке данных росла и потребность в специализированных архитектурах. Каждая архитектура адаптирована для оптимизации конкретных задач, обеспечивая точность и эффективность.

- Являются ли квантовые нейронные сети будущим искусственного интеллекта? Хотя трудно сказать определенно, квантовые нейронные сети обладают значительными перспективами из-за их потенциальной скорости и вычислительной мощности. Они могут произвести революцию в таких областях, как задачи оптимизации и криптография.

- В чем разница между LSTM и GRU? И LSTM, и GRU являются типами рекуррентных нейронных сетей. LSTM имеют более сложную структуру с тремя стробирующими механизмами, позволяющими им сохранять информацию в течение более длительных периодов. GRU, с другой стороны, предлагают упрощенную структуру с меньшим количеством вентилей, что делает их потенциально более быстрыми в определенных задачах.

- Почему нейроморфные вычисления имеют большое значение? Нейроморфные вычисления, вдохновленные структурой человеческого мозга, обещают обучение в режиме реального времени, сниженное энергопотребление и более высокую скорость обработки. Эти чипы могли бы переопределить границы того, что машины могут изучать и обрабатывать.